La scelta è probabilmente legata al fatto che poche settimane fa Apple ha rimosso l’app di Tumblr dall’App Store per iOS in seguito alla scoperta di contenuti pedopornografici su Tumblr. L’app è rimasta disponibile su Google Play.

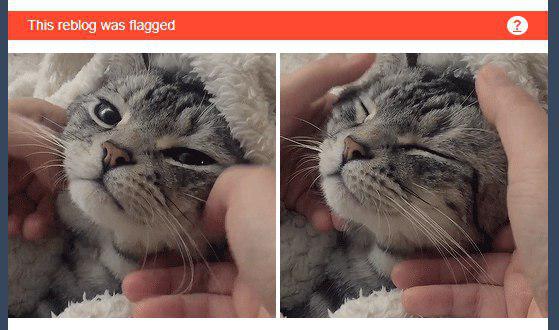

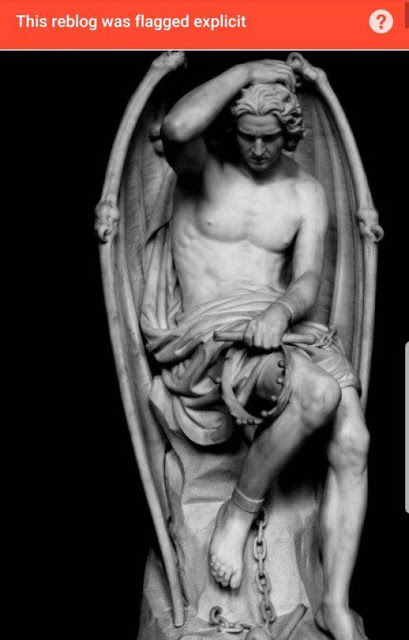

La decisione in sé può far discutere, ma la modalità usata per realizzarla è sicuramente un flop informatico di dimensioni spettacolari: il sistema di “intelligenza artificiale” adoperato per riconoscere i contenuti non più accettabili sta segnalando come inaccettabile ogni sorta di immagine assolutamente non pornografica e lasciando passare altre immagini estremamente esplicite. Ecco alcuni esempi:

Ne trovate altri qui, qui, qui e qui, dove si segnala che persino l’annuncio delle nuove regole da parte di Tumblr è stato etichettato come inaccettabile. Una dimostrazione perfetta del concetto che già è difficile per gli esseri umani decidere la differenza fra arte e pornografia, figuriamoci per un sistema di machine learning usato al posto di moderatori umani nella vana speranza di risparmiare soldi.

Su Twitter potete seguire l’hashtag #toosexyfortumblr.

Per ora la segnalazione è appellabile, ma stando agli utenti lo staff di Tumblr che dovrebbe vagliare i casi sta facendo più che altro confusione e discriminazione (i contenuti nazisti, per esempio, passano indisturbati).

Il risultato è, a giudicare dal calo del traffico su Tumblr (di proprietà di Verizon tramite Oath Inc), una fuga in massa degli utenti verso altri siti come Pillowfort.io:

Per il 17 dicembre è stata proposta una protesta di massa: 24 ore di inattività totale da parte degli utenti di Tumblr. Staremo a vedere.

Fonti: Wired, BBC, Wired.

Scritto da Paolo Attivissimo per il blog Il Disinformatico. Ripubblicabile liberamente se viene inclusa questa dicitura (dettagli). Sono ben accette le donazioni Paypal.