Chang’e-4, nuove immagini dalla faccia nascosta della Luna

11 de Janeiro de 2019, 11:42È stato reso pubblico poche ore fa un video dell’allunaggio della sonda cinese Chang’e-4: notate come la sonda, una volta assunto l’assetto verticale, si fermi in volo librato e poi si sposti, come se avesse valutato il terreno e cercato una zona pianeggiante dove posarsi.

Animazione accelerata dello scaricamento del rover Yutu 2 dalla sonda principale:

A sped-up gif of Yutu-2 being deployed onto the lunar surface. pic.twitter.com/q4sYstYtFX— Andrew Jones (@AJ_FI) 11 gennaio 2019

Il rover Yutu 2 fotografato dalla sonda principale:

A sua volta Yutu 2 ha fotografato la sonda principale: notate che le tracce delle ruote del Rover indicano che ha girato intorno alla sonda e si trova a un angolo di circa 120° dalla posizione di discesa.

Questo articolo vi arriva gratuitamente e senza pubblicità grazie alle donazioni dei lettori. Se vi è piaciuto, potete incoraggiarmi a scrivere ancora facendo una donazione anche voi, tramite Paypal (paypal.me/disinformatico), Bitcoin (3AN7DscEZN1x6CLR57e1fSA1LC3yQ387Pv) o altri metodi.

Hacker educato parla attraverso la telecamera insicura e aiuta a sistemarla

11 de Janeiro de 2019, 10:37 |

| Credit: Nest. |

Il signor Gregg ha spiegato all’Arizona Republic che ha avuto la prontezza di registrare col proprio telefonino quello che gli è successo: la voce era quella di un hacker canadese che gli ha spiegato di far parte di un gruppo di informatici che prende il controllo delle telecamere per avvisare gli utenti che sono vulnerabili perché hanno impostato maldestramente questi dispositivi.

Come tanti altri, anche Gregg aveva protetto (si fa per dire) la propria Nest con la stessa password che usava per i propri account di altri servizi Internet. Uno di questi servizi era stato violato, come capita spesso, e quindi la sua login e la sua password erano in giro su Internet, a disposizione di qualunque malintenzionato, il cui primo tentativo sarebbe stato quello di provare a entrare con quella password in tutti gli account legati alla persona.

Gregg non aveva neanche usato l’autenticazione a due fattori, disponibile sull’app Nest. Gli è andata bene: avrebbero potuto rubargli l’indirizzo di mail account, prendere il controllo del suo profilo Facebook profile, ordinare merci su Amazon, e altro ancora. Invece l’incontro con l’hacker lo ha convinto a cambiare le proprie password e a scollegare la telecamera.

Non aspettate un incontro analogo per fare altrettanto.

Roomba diventa una periferica di gioco molto particolare

11 de Janeiro de 2019, 9:57Roomba, l’aspirapolvere automatico di iRobot, ha una funzione poco conosciuta ma piuttosto ficcanaso: quando esplora la casa per memorizzare una mappa degli ostacoli e della zona che deve pulire, trasmette questa mappa e molti altri dati all’azienda, che si riserva la facoltà di cederli a terzi (per esempio Amazon, come descritto qui su Gizmodo).Se consegnare a sconosciuti una mappa completa di casa vostra vi lascia un po’ perplessi, c’è chi invece la prende con spirito ludico, come Rich Whitehouse, uno sviluppatore di videogiochi che ha pensato di usare i dati acquisiti dai Roomba per creare un livello di gioco di Doom basato sulla disposizione dei mobili della casa del giocatore.

Se vi stuzzica l’idea di inseguire mostri nel vostro soggiorno, non vi resta che scaricare il software gratuito di Whitehouse, ringraziandolo se possibile con una donazione, e seguire le sue istruzioni di installazione. Inevitabilmente, il software è stato battezzato da Whitehouse con un gioco di parole che anche secondo lui è terribile: Doomba.

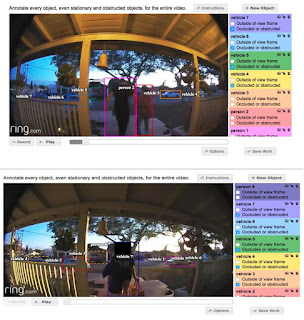

Campanelli digitali, video visibili a sconosciuti

11 de Janeiro de 2019, 7:33Se avete acquistato un campanello digitale Ring di Amazon, tenete presente che i video registrati da questo dispositivo possono essere stati condivisi con sconosciuti e guardati dallo staff dell’azienda.Secondo le indagini di The Intercept e di The Information, i video acquisiti da campanelli e telecamere di sorveglianza internet di questa marca venivano accumulati nel cloud di Amazon e messi a disposizione dei dipendenti in Ucraina e dei dirigenti negli Stati Uniti, senza crittografia per ridurre i costi e facilitare l’accesso. Per accedere a quello che vedevano le telecamere degli utenti era sufficiente conoscere il loro indirizzo di mail.

Inoltre la vantata “intelligenza” di riconoscimento delle immagini di queste telecamere era in realtà basata sull’instancabile e frenetico lavoro di un gran numero di dipendenti che esaminavano manualmente i video per valutarli. A giudicare dalle inserzioni su LinkedIn, questa prassi continua tuttora.

Secondo le fonti di The Intercept, “i dipendenti di Ring si scambiavano i video che stavano etichettando e descrivevano alcune delle cose che avevano visto, come persone che si baciavano, sparavano con armi da fuoco e rubavano”.

Di fronte a queste notizie, la maggior parte della gente reagisce dicendo “ma io non ho niente da nascondere”. Pensateci la prossima volta che vostra figlia torna a casa con il suo partner.

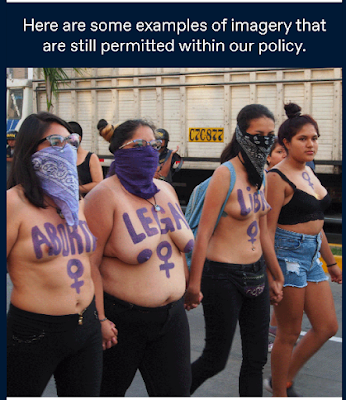

Tumblr, l'epic fail dell’“intelligenza artificiale” continua e peggiora

11 de Janeiro de 2019, 5:59Tumblr ha mantenuto la parola e dal 17 dicembre scorso non accetta più contenuti ritenuti “per adulti, compresi i contenuti sessuali espliciti e la nudità (con alcune eccezioni)”, dichiarando di voler diventare così “un Tumblr migliore e più positivo”. Ha iniziato a nascondere i contenuti di questo genere e ha eliminato il pulsante che consente agli utenti di chiedere un riesame della valutazione.

C’è un piccolo problema in questa transizione: per valutare l’enorme massa di contenuti pubblicati dagli utenti, Tumblr ha deciso di utilizzare una sorta di intelligenza artificiale: “Ci affidiamo a strumenti automatizzati per identificare i contenuti per adulti e gli esseri umani per aiutare ad addestrare e tenere sotto controllo i nostri sistemi. Sappiamo che ci saranno errori“, scrive Tumblr. Mai parole finali furono più profetiche.

Gli “strumenti automatizzati” di Tumblr sono diventati la barzelletta di Internet, bloccando di tutto, comprese immagini religiose e persino i post che prendono in giro i suoi errori di riconoscimento in una sorta di Inception ricorsiva, come nota Boingboing (l’errore è stato poi corretto grazie all’intervento manuale di un moderatore):

Forse l’errore più comico è che Tumblr segnala come inaccettabili anche gli esempi di immagini che Tumblr stesso ha creato per mostrare cosa è accettabile e cosa non lo è:

Puntualmente, i prodigiosi “sistemi automatizzati” di Tumblr hanno immediatamente bloccato queste immagini:

Mentre l’ilarità continua, casi come questo possono servire da promemoria ben più serio per tutti quelli che periodicamente partoriscono l‘idea di affidare la sorveglianza dei contenuti e delle persone ai sistemi di riconoscimento automatico. Senza un esercito di esseri umani addestrati a valutare i singoli casi e un modo di contestare gli inevitabili errori, questi sistemi rischiano di essere un autogol formidabile.